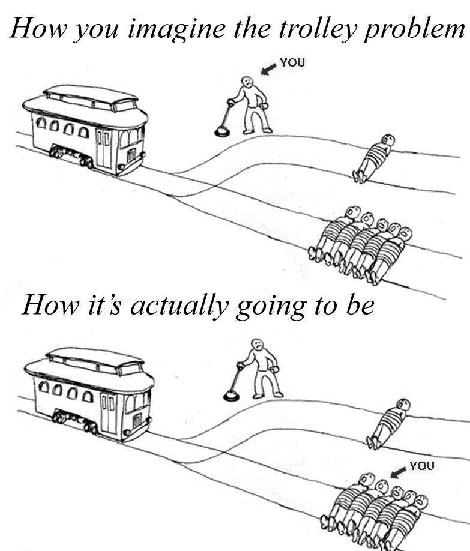

Por mucho que los humanos nos devanemos los sesos con disquisiciones sobre cómo programar la inteligencia artificial de los coches autónomos de un modo moralmente justo y nos enfrentemos a cuestiones como el dilema del tranvía, el asunto no tiene fácil solución. O sí.

En un artículo de The Guardian en X, el proyecto de coche autónomo de Google, disfrutan pensando en el dilema del tranvía. La cuestión es que el problema no es para tanto. Lo explican con todo detalle en Self-driving cars don’t care about your moral dilemmas:

Lo primero que hay que tener en cuenta es que todavía no nos hemos encontrado con ese problema. Nunca nos hemos encontrado en una situación en la que haya habido que elegir entre atropellar a un bebé o a una ancianita. E incluso si tuviéramos que enfrentarnos a esa situación probablemente significaría que alguien ha cometido un error unos segundos antes. Así que en el papel de «ingeniero moral» que entro a trabajar en la oficina mi objetivo es impedir que llegue a producirse esa situación. Eso significaría que la habríamos cagado antes.

Y aunque le quite intriga al asunto la respuesta es casi siempre pisar el freno a fondo. Normalmente tenemos más información sobre lo que sucede justo enfrente del vehículo –por cómo funcionan los sensores– y el control del coche también es mucho más preciso frenando que si intentando esquivar algo.

Así que tendría que tratarse de una situación realmente extrema para que tuviéramos que llegar a plantear otra respuesta.

¡Dilema resuelto! Como siempre la teoría es la teoría pero las cosas en la práctica no siempre son como dice la teoría.