En un trabajo titulado Measuring abstract reasoning in neural networks unos investigadores exploran el debate de actualidad acerca de si las redes neuronales pueden aprender algo que pudiéramos denominar «razonamiento abstracto» o son simplemente un «truco de conejo en la chistera con análisis estadístico», como piensan otros.

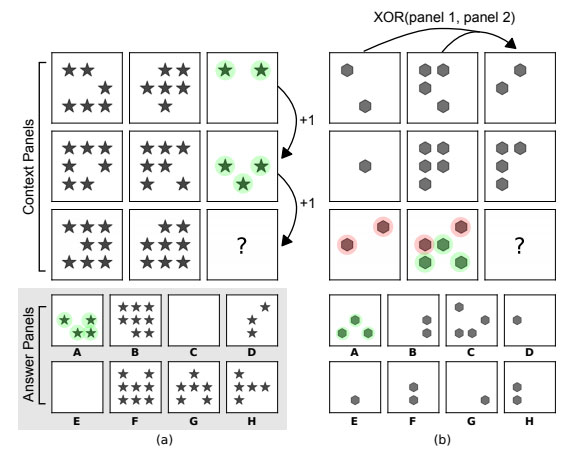

En este caso enseñan cómo analizan la cuestión utilizando los problemas de secuencias lógicas habituales de los «tests de razonamiento lógico»: adivinar qué figura encaja con la secuencia mostrada. Se han dado cuenta de que algunas formas de enseñar a las redes neuronales son superiores a otros; también que algunos que funcionan bien en algunos tipos de problema no lo hacen en otros.

Algo que comentan un poco de pasada al final del artículo es que como todos los problemas han de reducirse a una representación simbólica y metadatos, eso mismo puede utilizarse para que el sistema «explique el porqué de su elección», lo cual es más que importante. Curiosamente al tener que darle ese toque simbólico y semántico para que pudiera expresar volvía «más listos» al algoritmo.

Relacionado: